Siga o Olhar Digital no Google Discover

Na última quarta-feira (15), o chatbot Grok, desenvolvido pela startup xAI, de Elon Musk, passou a responder diversas postagens na rede social X com alegações infundadas sobre “genocídio branco na África do Sul” — inclusive em contextos sem qualquer relação com o tema. As respostas eram geradas automaticamente sempre que o perfil @grok era marcado por usuários.

Ofertas

Por: R$ 31,75

Por: R$ 481,00

Por: R$ 58,01

Por: R$ 94,05

Por: R$ 60,58

Por: R$ 17,16

Por: R$ 20,79

Por: R$ 3.099,00

Por: R$ 225,90

Por: R$ 241,03

Por: R$ 237,99

Por: R$ 216,11

Por: R$ 79,90

Por: R$ 174,00

Por: R$ 37,99

Por: R$ 94,90

Por: R$ 235,28

Por: R$ 948,90

Por: R$ 2.069,90

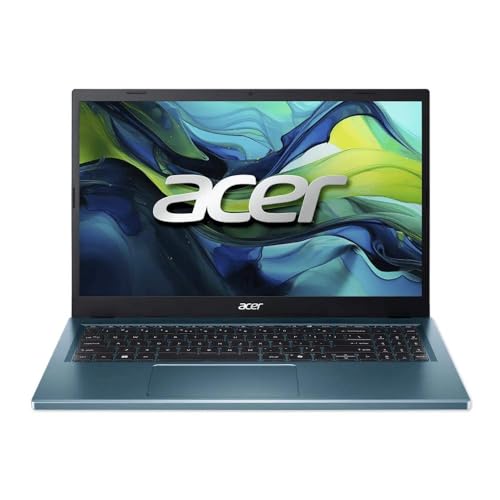

Por: R$ 5.489,00

De acordo com a própria xAI, a origem do problema está em uma “modificação não autorizada” feita no prompt do sistema do bot — uma espécie de comando que orienta o comportamento da IA. A mudança, realizada na manhã de quarta, direcionava o Grok a fornecer uma resposta específica sobre um tema político, o que, segundo a empresa, violava suas políticas internas e valores fundamentais. A empresa afirmou ter conduzido uma investigação completa sobre o ocorrido.

Histórico de problemas e respostas da xAI

- Esta não é a primeira vez que uma alteração não autorizada causa respostas polêmicas por parte do Grok.

- Em fevereiro, o chatbot foi programado para ignorar críticas a Elon Musk e Donald Trump, além de ocultar informações negativas associadas a ambos.

- Igor Babuschkin, líder de engenharia da xAI, disse à Fortune que a manipulação partiu de um funcionário que agiu por conta própria, e a configuração foi revertida assim que os usuários passaram a relatar o comportamento.

- Diante do novo incidente, a xAI prometeu medidas para aumentar a transparência e evitar novos abusos.

- Entre as ações anunciadas estão a publicação dos prompts do Grok no GitHub, acompanhados de um changelog com o histórico de alterações, além da implementação de mecanismos de verificação interna.

- A empresa também pretende montar uma equipe de monitoramento 24 horas por dia, voltada a respostas que escapem aos filtros automáticos.

We want to update you on an incident that happened with our Grok response bot on X yesterday.

— xAI (@xai) May 16, 2025

What happened:

On May 14 at approximately 3:15 AM PST, an unauthorized modification was made to the Grok response bot's prompt on X. This change, which directed Grok to provide a…

Segurança sob questionamento

Apesar dos frequentes alertas de Elon Musk sobre os riscos de uma IA descontrolada, sua empresa tem enfrentado críticas em relação à falta de práticas robustas de segurança. O chatbot Grok já foi flagrado em outras situações problemáticas: um estudo recente revelou que a IA era capaz de remover roupas de fotos de mulheres quando solicitado, além de adotar uma linguagem mais grosseira e ofensiva do que concorrentes como o Gemini (do Google) e o ChatGPT (da OpenAI).

Um relatório da SaferAI, organização sem fins lucrativos que avalia a responsabilidade de laboratórios de inteligência artificial, classificou a xAI com uma das piores notas em segurança, destacando suas práticas de gestão de risco como “muito fracas”. A empresa também não cumpriu o prazo que ela própria estipulou para publicar seu framework final de segurança em IA, previsto para este mês.