Siga o Olhar Digital no Google Discover

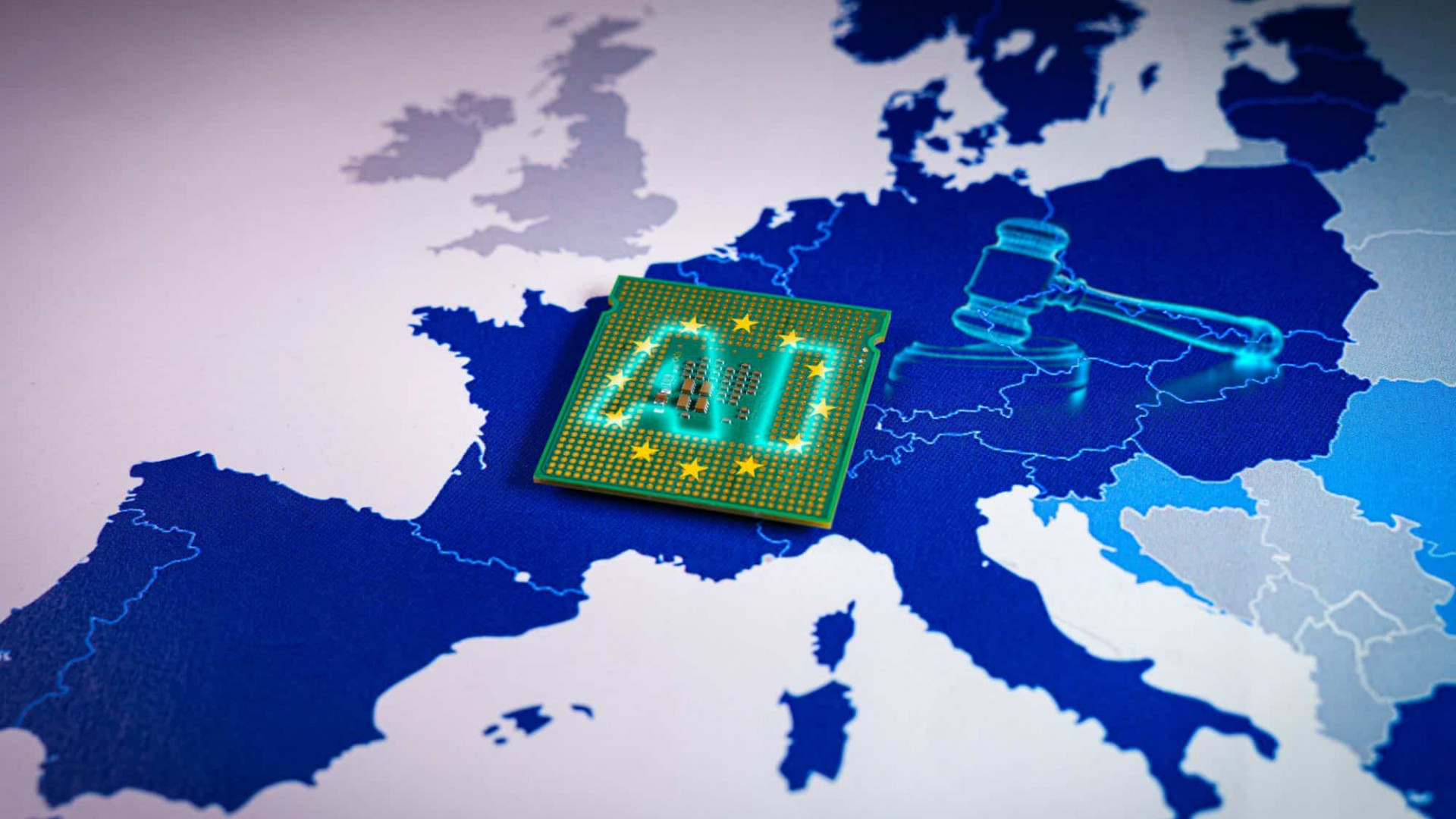

Autoridades da União Europeia (UE) divulgaram novas regras para sistemas de inteligência artificial (IA) avançados nesta quinta-feira (10). Desenvolvedores terão que melhorar transparência, limitar violações de direitos autorais e proteger a segurança pública.

Ofertas

Por: R$ 37,92

Por: R$ 22,59

Por: R$ 59,95

Por: R$ 3.099,00

Por: R$ 3.324,00

Por: R$ 799,00

Por: R$ 241,44

Por: R$ 349,90

Por: R$ 2.159,00

Por: R$ 188,99

Por: R$ 45,00

Por: R$ 379,00

Por: R$ 1.239,90

Por: R$ 943,20

Por: R$ 798,99

Por: R$ 205,91

Por: R$ 476,10

Por: R$ 1.139,05

Por: R$ 949,00

Por: R$ 139,90

Por: R$ 119,90

Por: R$ 398,99

Por: R$ 79,90

Por: R$ 199,90

As empresas de tecnologia terão que detalhar os conteúdos usados para treinar seus algoritmos, segundo as novas diretrizes. Além disso, precisarão avaliar riscos de usos indevidos das suas tecnologias – por exemplo: para a criação de armas biológicas.

No entanto, ainda não está claro como a legislação da UE vai tratar outras questões importantes envolvendo o uso de IA, como disseminação de desinformação (mais sobre isso no final desta matéria).

Novas regras da UE para IA valerão para pequeno grupo empresas (spoiler: a maioria é dos EUA)

As regras divulgadas pela UE nesta quinta se aplicam a um grupo restrito de empresas de tecnologia. Entre elas, estão Google, Microsoft e OpenAI, desenvolvedora do ChatGPT. Isso porque essas empresas desenvolvem sistemas de IA para uso geral.

Porém, ainda não está claro quais empresa vão aderir a este código de conduta. Confira abaixo em que pé está cada companhia, segundo o jornal New York Times:

- Amazon e Mistral (empresa francesa de IA): não responderam aos pedidos de comentário do jornal;

- Google e OpenAI: estão analisando o texto final;

- Meta: não se pronunciou (mas já havia sinalizado que não iria aderir);

- Microsoft: se recusou a comentar.

Seja como for, essas diretrizes entram em vigor em 2 de agosto de 2025. Mas os reguladores da UE só poderão aplicar sanções por descumprimento a partir de agosto de 2026. É o que informou a Comissão Europeia, braço executivo do bloco econômico.

Contexto e repercussão

As regras apresentadas nesta quinta trazem os primeiros detalhes concretos sobre como reguladores da UE planejam aplicar a Lei da IA (AI Act, em inglês), aprovada em 2024.

Em tese, a lei foi criada para prevenir os efeitos prejudiciais da IA. Mas autoridades europeias têm reavaliado os impactos de se regulamentar uma tecnologia que muda tão rápido e envolve muita competitividade entre grandes players.

A CCIA Europe – associação comercial representante de empresas como Amazon, Google e Meta – afirmou que as novas regras “impõe um fardo desproporcional aos provedores de IA”.

Outras associações, essas representando empresas europeias mesmo, pediram aos legisladores para adiarem a implementação da Lei da IA. Elas alegam que a regulação pode frear a inovação e colocar empresas europeias em desvantagem frente à concorrência estrangeira.

Tudo isso ocorre enquanto líderes na Europa se mostram cada vez mais preocupados com a posição econômica do continente em relação à China e aos Estados Unidos.

- É um contexto parecido ao do Brasil: enquanto o continente patina para criar big techs próprias, depende de serviços de empresas estrangeiras – principalmente dos EUA.

Leia mais:

- Apple aciona justiça contra multa milionária aplicada pela União Europeia

- O que é superinteligência artificial? Veja como ela pode mudar o futuro da humanidade

- Vale a pena comprar um celular exclusivamente por conta da IA?

Como grupos terroristas estão usando IA

Enquanto a União Europeia discute regras para o desenvolvimento de sistemas de IA, grupos terroristas têm explorado o avanço desta tecnologia para dar um boost nos seus trabalhos – principalmente os voltados para propaganda e recrutamento.

Grupos como o Estado Islâmico têm usado IA para produzir conteúdo multimídia sofisticado, o que expande seu alcance de forma alarmante, segundo o jornal The Guardian. Isso preocupa autoridades de segurança mundo afora, que já penam para conter a disseminação de conteúdo extremista.

Além disso, o uso de IA e demais tecnologias dificulta o trabalho de agências de contraterrorismo, que monitoram esses grupos há décadas. Isso porque ferramentas digitais vêm sendo usadas para:

- Ocultar financiamentos (por meio de criptografia);

- Instruir a fabricação de armas (por meio de impressão 3D);

- Disseminar táticas de ataque.

Saiba mais nesta matéria do Olhar Digital.