Siga o Olhar Digital no Google Discover

A disputa entre a Nvidia e o Google por espaço na infraestrutura da inteligência artificial ganhou novo fôlego nos últimos meses.

Ofertas

Por: R$ 22,59

Por: R$ 59,95

Por: R$ 3.099,00

Por: R$ 3.324,00

Por: R$ 799,00

Por: R$ 241,44

Por: R$ 349,90

Por: R$ 2.159,00

Por: R$ 188,99

Por: R$ 45,00

Por: R$ 379,00

Por: R$ 1.239,90

Por: R$ 943,20

Por: R$ 798,99

Por: R$ 205,91

Por: R$ 476,10

Por: R$ 1.139,05

Por: R$ 949,00

Por: R$ 7,60

Por: R$ 21,77

Por: R$ 16,63

Por: R$ 59,95

Por: R$ 7,20

Por: R$ 139,90

Por: R$ 119,90

Por: R$ 398,99

Por: R$ 79,90

Por: R$ 199,90

De um lado, a Nvidia reafirma que suas GPUs continuam “uma geração à frente” da concorrência; do outro, o Google avança com as TPUs de sétima geração (incluindo o novo chip Ironwood) e com o modelo Gemini 3, ambos projetados para entregar eficiência e desempenho superiores.

A disputa reacende a pergunta que domina o setor: afinal, o que diferencia uma GPU de uma TPU e por que isso está moldando o futuro da IA?

GPU vs TPU: duas arquiteturas criadas para missões diferentes

As GPUs (Graphics Processing Units) da Nvidia se tornaram o padrão de mercado para treinar e executar modelos de IA. Uma liderança tão consolidada que a empresa detém mais de 90% do mercado global de chips de inteligência artificial. Esse domínio foi reforçado pela chegada da geração Blackwell, considerada por especialistas a mais poderosa da empresa, capaz de acelerar significativamente o treinamento de modelos gigantes.

Originalmente pensadas para gráficos, as GPUs evoluíram para lidar com cargas paralelas intensas – justamente o tipo de tarefa exigida pelo deep learning. A grande vantagem está no ecossistema maduro, compatível e amplamente usado por pesquisadores e empresas em todo o mundo.

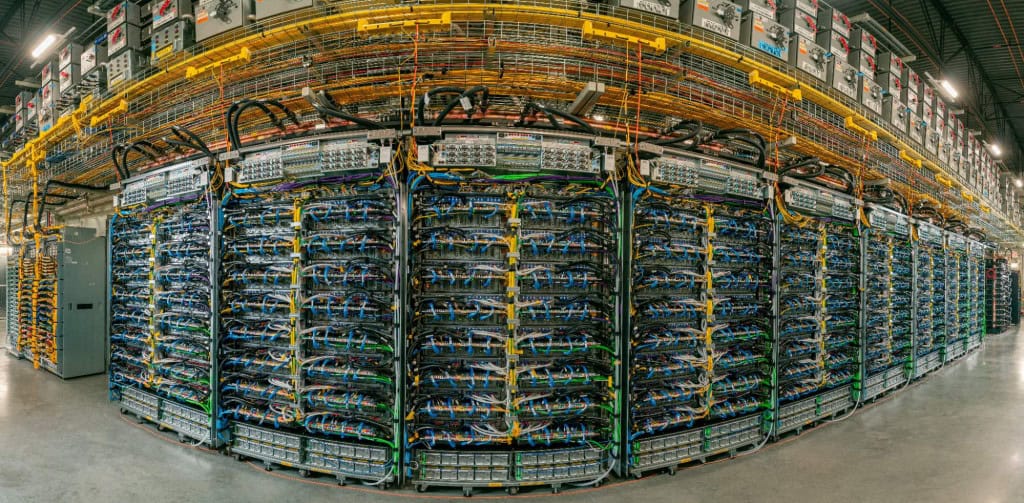

Já as TPUs (Tensor Processing Units) do Google seguem outro caminho. Elas são ASICs, chips feitos sob medida para cálculos de tensores e matrizes, o “coração” matemático da IA moderna. Essa especialização torna as TPUs mais eficientes em energia e throughput, além de escalarem melhor em grandes clusters.

Em outras palavras, as TPUs não apenas consomem menos energia para realizar cada operação, como também conseguem processar uma quantidade maior de trabalho por segundo e atuar em conjunto como se fossem uma única máquina. Essa arquitetura permite treinar modelos enormes de maneira mais rápida e eficiente, algo essencial na corrida da inteligência artificial.

É justamente esse pacote (chip, modelo, compilador e nuvem) que dá ao Google uma integração vertical difícil de replicar.

Como explicou ao Olhar Digital a matemática e economista Nicole Grossmann, especializada em inteligência artificial pelo Georgia Tech, “as TPUs são chips feitos sob medida para operação de tensores, onde mora o núcleo do deep learning. Por serem especializadas, elas são muito mais eficientes em termos de watt e escalabilidade para cargas de IA”.

A resposta da Nvidia: flexibilidade e domínio de ecossistema

Mesmo diante do avanço das TPUs, a Nvidia segue confortável no topo, e faz questão de reforçar isso publicamente. A empresa destaca que sua plataforma é a única capaz de rodar todos os grandes modelos de IA e de atender a praticamente qualquer tipo de workload.

A compatibilidade universal é o segredo do time de Jensen Huang. Migrar um pipeline inteiro – modelos, bibliotecas, frameworks e infraestrutura – para TPUs não é simples. É por isso que analistas consideram improvável uma transição rápida ou massiva.

Nicole Grossmann reforça esse ponto: “A Nvidia continua muito forte porque oferece versatilidade e compatibilidade universal. O ecossistema de pesquisa já está todo adaptado para GPU, e migrar para TPU não é trivial”.

O salto do Google com o Gemini 3 e com o chip Ironwood

O Google vive seu momento de virada: o lançamento do modelo Gemini 3 e da arquitetura Ironwood reposicionou a empresa no topo das conversas sobre IA. A nova TPU foi criada para treinar modelos gigantes com mais eficiência e menor consumo energético, algo essencial à medida que os custos da IA disparam.

E o impacto tem sido imediato. Segundo a CNBC, as ações da Alphabet subiram rapidamente após o anúncio, refletindo a confiança do mercado. O interesse corporativo cresce ainda mais quando combinado à imensa vantagem de dados do Google – especialmente graças ao YouTube, que garante acesso a um volume incomparável de vídeos para treinar modelos multimodais.

Essa combinação – infraestrutura proprietária, dados abundantes e integração total – dá ao Google uma base rara no setor.

Multihardware: o futuro da IA será híbrido, não monopolizado

Apesar da narrativa competitiva, especialistas concordam que a disputa Nvidia vs Google não deve resultar em um único vencedor. O mercado deve caminhar para um ecossistema híbrido, no qual diferentes chips atendem usos distintos, e coexistem.

Nas palavras de Nicole Grossmann: “Minha conclusão é de que não vai ser um mercado de monopólio. Com Google, Nvidia e outros aceleradores, caminhamos para um ecossistema de multi-hardware, onde vários chips atendem diferentes usos e competem entre si”.

Essa diversidade pode ser positiva para todo o setor: competição costuma acelerar inovação, reduzir custos e abrir espaço para novas abordagens em semicondutores e infraestrutura.

A escolha entre GPU e TPU depende do objetivo

A disputa entre Nvidia e Google não é uma batalha pelo “chip definitivo”, mas por diferentes caminhos que atendam necessidades distintas. GPUs ainda dominam pela compatibilidade e pela versatilidade; já as TPUs se destacam pela eficiência, desempenho e integração total com a nuvem e modelos do Google.

Lançado no I/O de 2024, o Trillium trouxe um salto de até 4,7 vezes no desempenho e melhorias importantes em memória e largura de banda.

Já o recém-anunciado Ironwood, a sétima geração de TPUs do Google eleva essa capacidade: cada chip é até quatro vezes mais eficiente em tarefas de treinamento e inferência, e o sistema foi pensado para escalar com milhares de TPUs trabalhando em conjunto em pods de alta performance, como parte da nova estratégia de supercomputação do Google Cloud.

Para empresas, desenvolvedores e pesquisadores, o impacto é claro: a tendência é que projetos de IA passem a considerar mais de uma arquitetura de hardware, escolhendo a ferramenta certa para cada tipo de carga de trabalho.