Siga o Olhar Digital no Google Discover

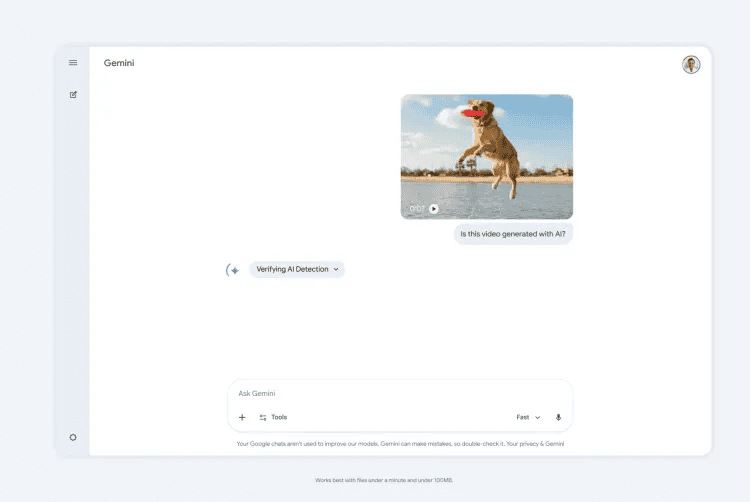

O Google ampliou as capacidades de verificação de conteúdo do Gemini e passou a permitir a análise de vídeos criados ou editados com seus próprios modelos de inteligência artificial (IA).

Ofertas

Por: R$ 22,59

Por: R$ 59,95

Por: R$ 3.099,00

Por: R$ 3.324,00

Por: R$ 799,00

Por: R$ 241,44

Por: R$ 349,90

Por: R$ 2.159,00

Por: R$ 188,99

Por: R$ 45,00

Por: R$ 379,00

Por: R$ 1.239,90

Por: R$ 943,20

Por: R$ 798,99

Por: R$ 205,91

Por: R$ 476,10

Por: R$ 1.139,05

Por: R$ 949,00

Por: R$ 7,60

Por: R$ 21,77

Por: R$ 16,63

Por: R$ 59,95

Por: R$ 7,20

Por: R$ 139,90

Por: R$ 119,90

Por: R$ 398,99

Por: R$ 79,90

Por: R$ 199,90

A partir de agora, usuários podem enviar um vídeo ao assistente e perguntar diretamente se ele foi gerado com IA do Google, recebendo uma resposta detalhada baseada em sinais técnicos incorporados ao material.

A novidade expande um recurso lançado em novembro, quando o Gemini passou a identificar imagens produzidas ou alteradas com ferramentas de IA da empresa. Na ocasião, o Google já havia sinalizado que o suporte a vídeos chegaria em breve.

Como funciona a verificação de vídeos

- O Gemini analisa tanto os elementos visuais quanto o áudio em busca do SynthID, a marca d’água digital proprietária do Google.

- Segundo a empresa, o sistema não se limita a confirmar ou negar a origem do vídeo: ele também aponta momentos específicos em que a marca d’água aparece, oferecendo mais transparência sobre quais trechos foram afetados por ferramentas de IA.

- O recurso é compatível com vídeos de até 100 MB e 90 segundos e está disponível em todos os países e idiomas onde o aplicativo Gemini opera.

Leia mais:

- Google quer revolucionar edição de imagens com IA usando o Nano Banana Pro

- Gemini 3 fez sucesso: ações da Alphabet, dona do Google, dispararam nesta quarta-feira

- Google disponibiliza a fonte “Sans Flex” gratuitamente

Limites da marcação e o desafio dos deepfakes

Embora o Google descreva o SynthID como “imperceptível”, ainda não está claro o quão resistente ele é à remoção ou se outras plataformas conseguirão detectar facilmente essas informações.

O tema ganhou destaque recentemente após a OpenAI reconhecer que marcas d’água em vídeos do Sora podiam ser removidas com relativa facilidade.

O Google também incorpora metadados no padrão C2PA em alguns conteúdos gerados por IA, mas a falta de uma adoção coordenada entre redes sociais e plataformas de vídeo continua permitindo que deepfakes circulem sem identificação clara.

Com a expansão para vídeos, o Google dá mais um passo para oferecer ferramentas de verificação, mas o combate à desinformação gerada por IA ainda depende de padrões mais amplos e interoperáveis.