Siga o Olhar Digital no Google Discover

O Google decidiu remover resumos gerados por inteligência artificial (IA) de buscas sobre saúde após uma investigação revelar que a ferramenta fornecia orientações incorretas e potencialmente perigosas. A mudança vale para buscas sobre exames laboratoriais, nas quais a IA falhava em considerar variáveis cruciais para o diagnóstico médico.

Ofertas

Por: R$ 4,66

Por: R$ 241,44

Por: R$ 241,44

Por: R$ 1.449,99

Por: R$ 3.799,00

Por: R$ 1.999,99

Por: R$ 899,00

Por: R$ 889,00

Por: R$ 79,90

Por: R$ 59,90

Por: R$ 3.324,00

Por: R$ 241,44

Por: R$ 188,99

Por: R$ 949,00

O recuo acontece num momento de pressão sobre a confiabilidade das visões gerais criadas por IA na Busca do Google, que prometiam simplificar a busca por informações essenciais. Especialistas alertam que erros em temas médicos não são apenas falhas técnicas, mas representam riscos reais que podem levar pacientes a ignorar sintomas graves ou abandonar tratamentos essenciais.

Erros em diagnósticos e tratamentos forçam Google a restringir resumos gerados por IA

Segundo investigação do jornal The Guardian, a IA do Google ignorava fatores como idade, sexo e etnia ao explicar resultados de exames de sangue. Sem esse contexto, números que pareciam normais na tela poderiam mascarar doenças hepáticas severas em determinados perfis de pacientes, o que gerava uma falsa sensação de segurança.

Em casos mais extremos, a ferramenta recomendou que pacientes com câncer de pâncreas evitassem alimentos gordurosos, o oposto do protocolo médico padrão. Seguir esse conselho impediria a ingestão necessária de calorias, o que poderia comprometer diretamente a resistência física do paciente para suportar a quimioterapia ou cirurgias vitais.

Outras falhas graves incluíram a indicação do exame de Papanicolau para detectar câncer vaginal, associação tecnicamente errada que pode atrasar o diagnóstico correto. Além disso, orientações sobre saúde mental, como psicose e distúrbios alimentares, foram classificadas por especialistas como prejudiciais por reforçarem estigmas e oferecerem conselhos perigosos.

O Google alega que a maioria dos resumos é útil. E acrescentou que toma medidas corretivas quando a IA perde o contexto ou interpreta mal o conteúdo da web. No entanto, entidades de saúde criticam a postura de remover apenas termos específicos, tratando o problema como pontual em vez de resolver a falha sistêmica da IA na hora de lidar com saúde.

Mesmo com as remoções, variações de termos técnicos ainda podem acionar resumos automáticos em algumas buscas, segundo o jornal.

Anthropic e OpenAI apostam em dados técnicos e integração direta para evitar alucinações

Enquanto o Google enfrenta crises de precisão em sua busca aberta, a Anthropic lançou o Claude for Healthcare para atuar de forma especializada no setor. O foco desta ferramenta não é o público leigo, mas sim transformar a IA num assistente para médicos e pesquisadores que lidam com prontuários e exames.

A nova plataforma utiliza o modelo Opus 4.5 para se conectar a bases oficiais, como o banco de dados do Medicare e o sistema CID-10 de códigos de doenças. Ao cruzar diretrizes clínicas com o histórico do paciente, o sistema agiliza processos burocráticos e ajuda a identificar falhas em testes clínicos e documentos regulatórios.

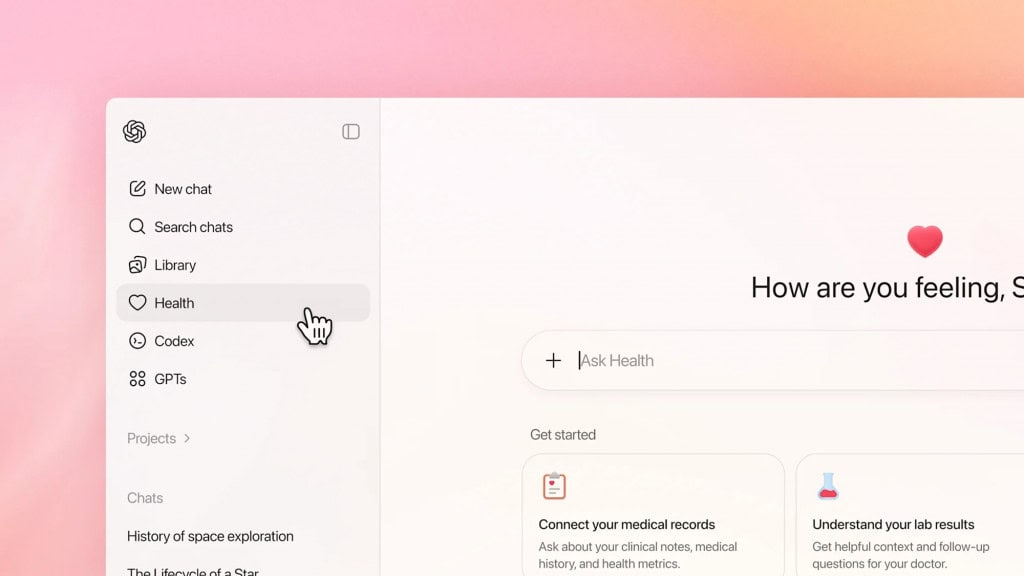

Em paralelo, a OpenAI apresentou o ChatGPT Health: uma espécie de hub para o usuário gerenciar seu próprio histórico de bem-estar de forma privada. Para garantir a segurança, a empresa utilizou o HealthBench, estrutura de avaliação desenvolvida com o apoio de mais de 260 médicos especialistas.

A proposta dessa integração é usar dados reais de dispositivos vestíveis, como o Apple Watch, para oferecer informações contextualizadas sobre sono e atividade física. Diferente dos resumos de busca genéricos, essas ferramentas são apresentadas como auxiliares de triagem, com o aviso constante de que não substituem o diagnóstico médico profissional.

Leia mais:

- Google quer transformar Gemini em assistente que faz compras por você

- 5 prompts do Gemini para organizar suas finanças

- 8 funções do Gemini que só funcionam no aplicativo

Essa mudança de paradigma em 2026 marca a transição das recomendações baseadas em buscas genéricas para uma IA integrada a dados técnicos e exames sob rigorosos protocolos. O desafio do setor agora é provar que esses novos sistemas conseguem manter a confiança dos pacientes e das instituições de saúde através da precisão absoluta.