Siga o Olhar Digital no Google Discover

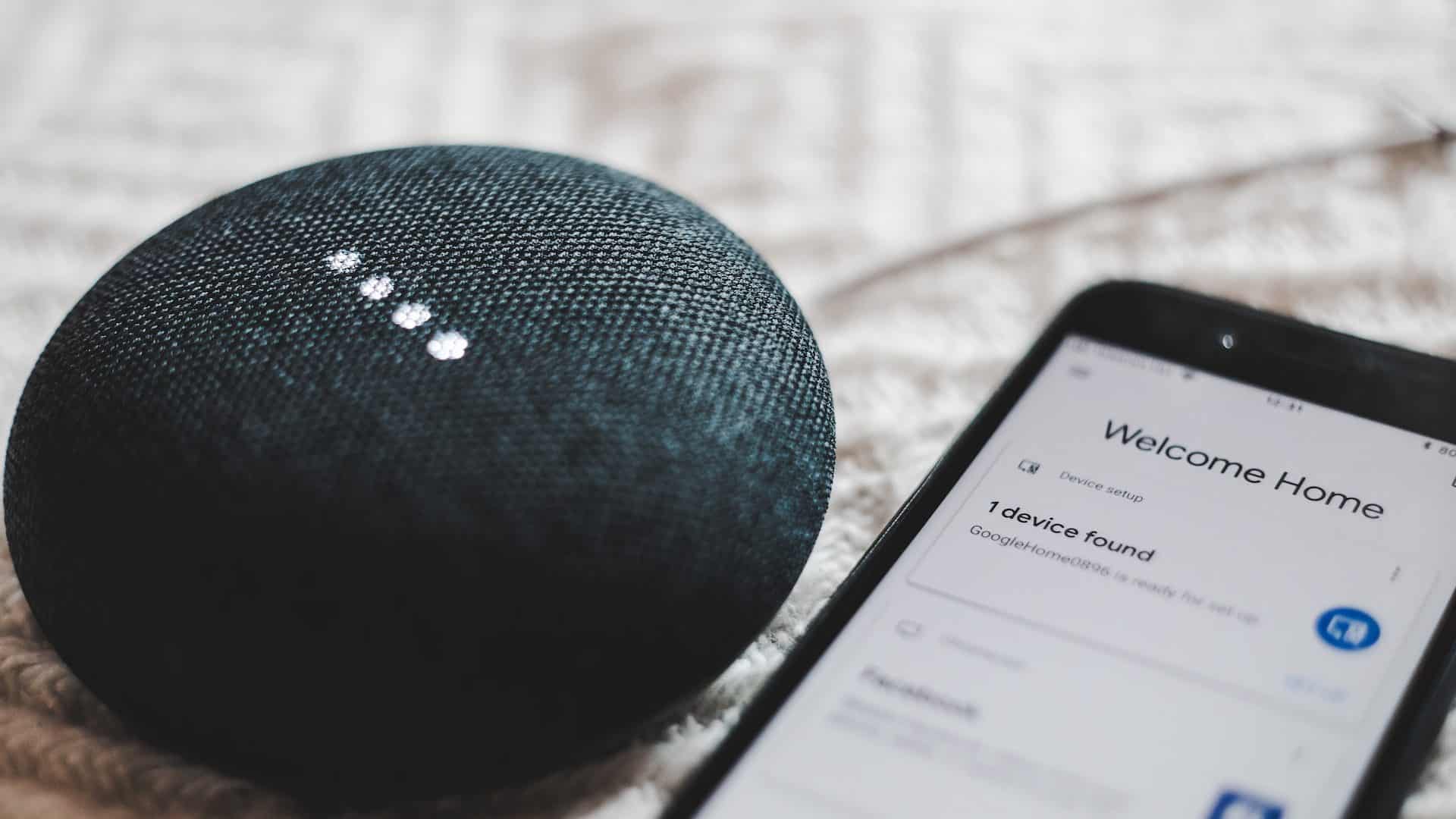

A voz da Siri, Alexa ou de outra assistente virtual não atrai todos os públicos. Na verdade, se o tom de voz e a personalidade dessas tecnologias fossem mais parecidas com as do proprietário, elas teriam mais credibilidade no que falam. Isso é o que mostra novo estudo da Universidade da Pensilvânia (EUA), que analisou como os usuários recebem essas assistentes a depender da semelhança consigo mesmo.

Ofertas

Por: R$ 36,21

Por: R$ 24,96

Por: R$ 9,90

Por: R$ 5,86

Por: R$ 113,70

Por: R$ 6,90

Por: R$ 37,92

Por: R$ 22,59

Por: R$ 59,95

Por: R$ 3.099,00

Por: R$ 3.324,00

Por: R$ 799,00

Por: R$ 241,44

Por: R$ 388,78

Por: R$ 2.159,00

Por: R$ 188,99

Por: R$ 45,00

Por: R$ 379,00

Por: R$ 1.239,90

Por: R$ 943,20

Por: R$ 798,99

Por: R$ 199,00

Por: R$ 476,10

Por: R$ 1.139,05

Por: R$ 949,00

Por: R$ 119,90

Por: R$ 398,99

Por: R$ 79,90

Por: R$ 199,90

Como o estudo foi feito

- Para o estudo, um grupo de pesquisadores coletou dados de como 401 participantes definem seu próprio nível de extroversão (introvertidos ou extrovertidos);

- Então, eles designaram essas pessoas a três grupos de controle diferentes para analisar como a personalidade de uma assistente de voz impacta no que ela diz e na experiência geral do usuário;

- Os participantes de alguns grupos foram confrontados aleatoriamente com a assistente introvertida ou extrovertida, enquanto outro grupo foi designada a uma assistente adaptada à personalidade da pessoa;

- Depois que os dispositivos fizeram uma breve introdução de fala, os voluntários tiveram de avaliar a experiência geral, a atratividade e a qualidade do serviço;

- Ainda, posteriormente, esses grupos foram confrontados com informações falsas sobre a vacinação da Covid-19 falada pelas assistentes dentro de seus respectivos grupos, para ver como eles a recebiam. Eles tiveram de reavaliar a experiência ao final.

Leia mais:

- Designer conversacional é imprescindível para personalização de Assistentes Virtuais

- 7 dicas de dispositivos eletrônicos para tornar a sua casa inteligente

- Amazon Echo com Alexa ou Google Nest? Qual é o melhor para você

Assistente virtual personalizada venceu

Os resultados mostraram que assistentes virtuais com voz e personalidade ajustada para se parecem com a do usuário tiveram recepção mais positiva do que as padronizadas. Além disso, os proprietários prestavam mais atenção no que elas tinham a dizer.

Isso foi exemplificado pelo caso da vacinação da Covid-19. Nos grupos em que a assistente personalizada proferiu informações falsas sobre a vacinação, participantes não vacinados duvidaram do que ela dizia. 38% dos não vacinados que participaram da pesquisa mudaram de ideia depois do teste.

Segundo os pesquisadores, quando a assistente tem personalidade ou voz mais parecida com a deles, os usuários tendem a ter mais consideração por ela.

No entanto, a situação da vacinação foi contra-intuitiva: ao invés de simplesmente acreditarem no que o dispositivo diz, os participantes realmente pensaram sobre o assunto e procuraram a fonte correta, o que indica que eles prestaram mais atenção no que foi dito.

De acordo com o TechXplore, isso, inclusive, os ajudou a criar resistência contra informações falsas, já que, uma vez que eles estão mais atentos e receptivos, eles tendem a desconfiar mais do que foi dito.