Siga o Olhar Digital no Google Discover

Usuários que recorrem ao ChatGPT para suporte emocional ou questões pessoais devem ter cautela, segundo o CEO da OpenAI, Sam Altman.

Ofertas

Por: R$ 7,39

Por: R$ 31,75

Por: R$ 481,00

Por: R$ 58,01

Por: R$ 94,05

Por: R$ 60,58

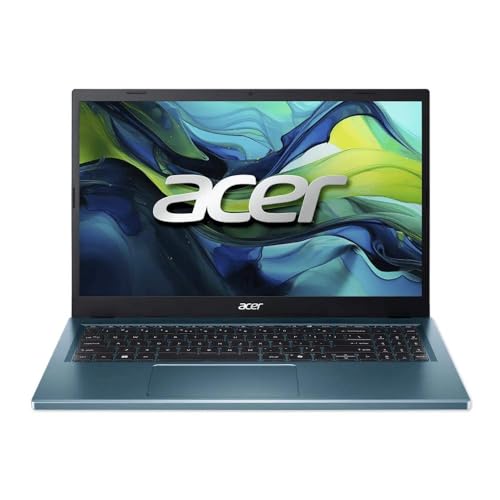

Por: R$ 3.799,00

Por: R$ 225,90

Por: R$ 241,03

Por: R$ 237,99

Por: R$ 216,11

Por: R$ 79,90

Por: R$ 174,00

Por: R$ 37,99

Por: R$ 94,90

Por: R$ 299,90

Por: R$ 948,90

Por: R$ 2.069,90

Por: R$ 5.489,00

Em entrevista ao podcast This Past Weekend, de Theo Von, Altman destacou que, diferente de conversas com médicos ou terapeutas, não existe proteção legal de confidencialidade nas interações com a IA.

“Pessoas compartilham detalhes profundamente pessoais com o ChatGPT, especialmente os jovens, tratando-o como terapeuta ou conselheiro”, disse Altman. No entanto, ele alertou que, ao contrário do sigilo médico ou jurídico, a IA não oferece garantias legais de privacidade, o que pode expor essas conversas em processos judiciais.

Leia mais:

- Como criar seu “próprio” ChatGPT; veja passo a passo

- Busca profunda no ChatGPT: o que é, como funciona, e como usar

- Stargate: OpenAI e Oracle investem em megaprojeto de data centers

Polêmica sobre uso de dados

- O CEO também comentou sobre os desafios legais que envolvem o armazenamento e a solicitação de dados de usuários.

- A OpenAI, por exemplo, está contestando uma ordem judicial no processo com o New York Times que exigiria o acesso a chats de milhões de usuários, exceto os do ChatGPT Enterprise.

- A empresa considera essa exigência um “exagero” que ameaça decisões internas sobre proteção de dados.

Altman defendeu a criação de um arcabouço jurídico para garantir aos usuários de IA o mesmo nível de confidencialidade já presente em outras profissões. “Faz sentido querer clareza jurídica sobre privacidade antes de usar a ferramenta com frequência”, afirmou.

Altman teme “crise de fraude” da IA

O CEO da OpenAI também afirmou recentemente que podemos estar à beira de uma “crise de fraude” por conta da forma como a inteligência artificial (IA) é capaz de “maquiar” a identidade de criminosos digitais. Leia mais sobre isso aqui.