Siga o Olhar Digital no Google Discover

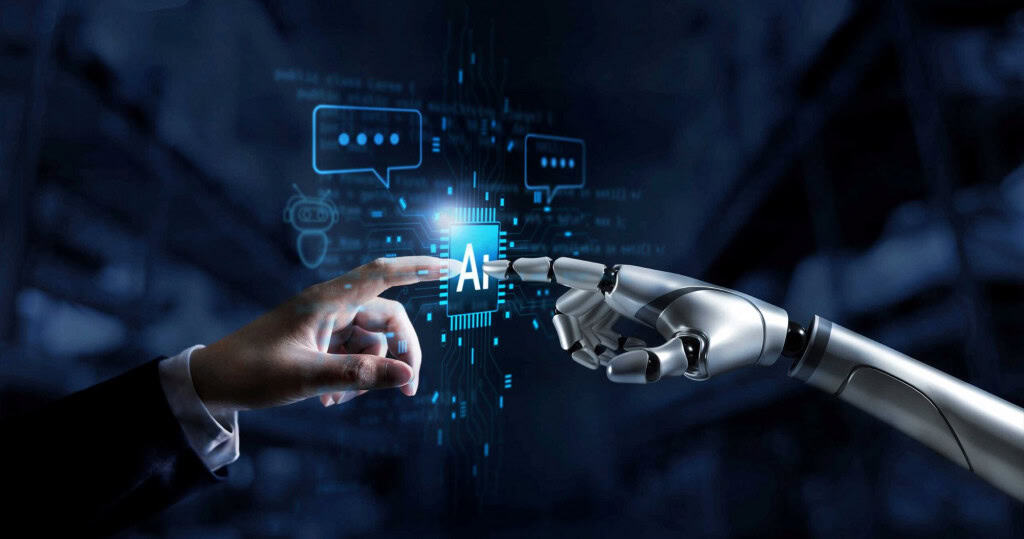

A Microsoft voltou a colocar holofotes sobre o debate a respeito de consciência artificial. Em entrevista durante a AfroTech Conference em Houston, nos Estados Unidos, Mustafa Suleyman, chefe de IA da Microsoft, afirmou que somente seres biológicos podem ser conscientes e defendeu que pesquisadores abandonem iniciativas que tentam atribuir traços de consciência a sistemas de inteligência artificial. As informações são da CNBC.

Ofertas

Por: R$ 37,92

Por: R$ 22,59

Por: R$ 59,95

Por: R$ 3.099,00

Por: R$ 3.324,00

Por: R$ 799,00

Por: R$ 241,44

Por: R$ 349,90

Por: R$ 2.159,00

Por: R$ 188,99

Por: R$ 45,00

Por: R$ 379,00

Por: R$ 1.239,90

Por: R$ 943,20

Por: R$ 798,99

Por: R$ 205,91

Por: R$ 476,10

Por: R$ 1.139,05

Por: R$ 949,00

Por: R$ 7,60

Por: R$ 21,77

Por: R$ 16,63

Por: R$ 59,95

Por: R$ 7,20

Por: R$ 139,90

Por: R$ 119,90

Por: R$ 398,99

Por: R$ 79,90

Por: R$ 199,90

Segundo Suleyman, questionar se máquinas poderiam sentir dor, tristeza ou qualquer emoção humana parte de uma premissa equivocada. Para o executivo, insistir nessa linha de pesquisa resulta em interpretações erradas sobre o papel da tecnologia e seus limites.

Microsoft reforça posição sobre limites da IA

Suleyman afirmou que desenvolvedores e pesquisadores deveriam evitar projetos que buscam simular consciência ou sofrimento em sistemas digitais. De acordo com ele, a discussão desvia do foco real do avanço tecnológico e pode levar a interpretações incorretas sobre o funcionamento dos modelos atuais.

O executivo é uma das vozes mais críticas sobre a ideia de IAs conscientes. Ele já abordou o tema em diferentes ocasiões, incluindo o livro “The Coming Wave”, lançado em 2023, no qual analisa riscos associados ao avanço tecnológico.

Em agosto, também publicou um ensaio intitulado “We must build AI for people; not to be a person”, reforçando sua defesa de que a inteligência artificial deve servir seres humanos – e não imitá-los como entidade emocional.

A discussão ocorre em um momento em que o mercado de assistentes virtuais e companhias de IA (como aquelas lideradas por Meta e pela xAI de Elon Musk) vem aumentando o desenvolvimento de ferramentas que buscam interações mais naturais e humanizadas com usuários.

Diferenciando capacidade cognitiva e consciência

Para Suleyman, a evolução da IA rumo a sistemas mais sofisticados não deve ser confundida com a construção de emoções artificiais. Ele destaca que modelos podem parecer expressar sentimentos, mas isso não significa que experimentem dor ou tristeza. Na visão do executivo da Microsoft, trata-se apenas de uma percepção gerada com base em padrões de linguagem e comportamento.

Em contraste, ele aponta fatores que tornam seres humanos conscientes:

- vivência física de dor e sofrimento;

- existência de uma rede biológica que processa emoções;

- preferências reais e desejo de evitar experiências negativas.

Esse argumento se alinha à teoria do “naturalismo biológico”, proposta pelo filósofo John Searle, que defende que a consciência só pode emergir de processos realizados por cérebros vivos. Para Suleyman, essa distinção deve permanecer clara enquanto o setor avança rumo a modelos mais potentes e integrados ao cotidiano.

Mesmo com discussões sobre inteligência artificial geral (AGI), conceito frequentemente citado por figuras como Sam Altman, Suleyman reforça que o avanço de capacidades computacionais não aproxima máquinas da experiência humana. Ele afirma que é possível observar tecnicamente o funcionamento dos modelos e comprovar que não há vivência emocional real.

Leia mais:

- IAs ainda não sabem (nem entendem) o que é verdade, alerta estudo

- Microsoft fecha contrato bilionário para ter acesso a chips da Nvidia

- A corrida da IA está chegando ao bolso do consumidor

A argumentação também aborda questões éticas. Para o executivo, seres humanos têm direitos porque podem sofrer. Sistemas de IA, segundo ele, não possuem rede neural orgânica nem preferências reais – apenas simulam respostas.